回旋镖来了。美国战争部长怒批Anthropic CEO:意识形态主义,不民主!这到底是个什么故事?

在当前的全球科技竞争中,AI技术的发展已经成为各国角逐的重要领域。尤其是在军事应用方面,各国都在积极探索如何利用AI提升其军事实力。Anthropic作为大模型领域的佼佼者,其拒绝参与武器制造的立场引起了广泛关注。

在此背景下,Anthropic的CEO达里奥·阿莫迪的发言引发了巨大争议。他的观点不仅仅是对技术应用的价值观表达,更是对整个行业道德底线的捍卫。这种思想在当今社会中尤为重要,尤其是在技术发展迅速的情况下,如何平衡伦理与科技应用成了一个迫切需要解决的问题。

我们可以看到,AI技术的应用范围不仅限于商业和民生,甚至已经渗透到国家安全的各个方面。从无人机到智能监控,AI的军事应用正在以迅猛的速度发展。这种发展虽然为国家安全提供了保障,但同时也引发了对技术滥用的担忧。

在这样的情况下,Anthropic的立场显得尤为鲜明。公司对于不参与自主武器的开发不仅仅是商业决策,更是道德责任的体现。企业在追求利润的同时,更应该关注其技术的社会影响,确保不对人类带来潜在威胁。

大家好,欢迎收听老范讲故事的Youtube频道。在达沃斯论坛上,Anthropic CEO达里奥·阿莫迪曾经说过,给中国供应H200,就相当于是向朝鲜销售核武器。这样的一个站在道德制高点上的人,现在被骂了,轮到他自己了。美国战争部长赫格塞斯召见了Anthropic CEO达里奥·阿莫迪,进行了一次不愉快的会面。所谓的不愉快会面,并没有出现在官方报道里边,但是据一些媒体从周边的人身上挖出来的,赫格塞斯确实是说了,这次会谈很不愉快。

此外,战争部与Anthropic之间的分歧还反映了科技与政策之间的矛盾。科技的发展往往超越了政策的适应能力,造成了二者之间的脱节。在这种情况下,如何建立有效的沟通机制,让政策及时跟上科技进步的步伐,是当前亟待解决的问题。

那么会谈的目的是什么?必须彻底废除所有的使用策略限制。我买你东西,你让我用就完了,我愿意怎么用怎么用,你别管我。他批判说达里奥·阿莫迪是阻碍战争的绊脚石、无可救药的意识形态分子、觉醒文化的怪胎,怒批达里奥·阿莫迪是不民主的。这个就是故事的开始。

这个故事咱们分四段来讲。第一段,战争部跟Anthropic之间分歧到底是什么?第二个,网上放大和过度解读的一些东西,咱们也要拿出来稍微掰扯一下。第三段,Anthropic这个曾经的唯一一家国防部授权大模型供应商,到底在坚持什么?最后,战争部为什么对于向Anthropic申请许可那么耿耿于怀?

首先咱们讲战争部和Anthropic之间的分歧到底是什么。

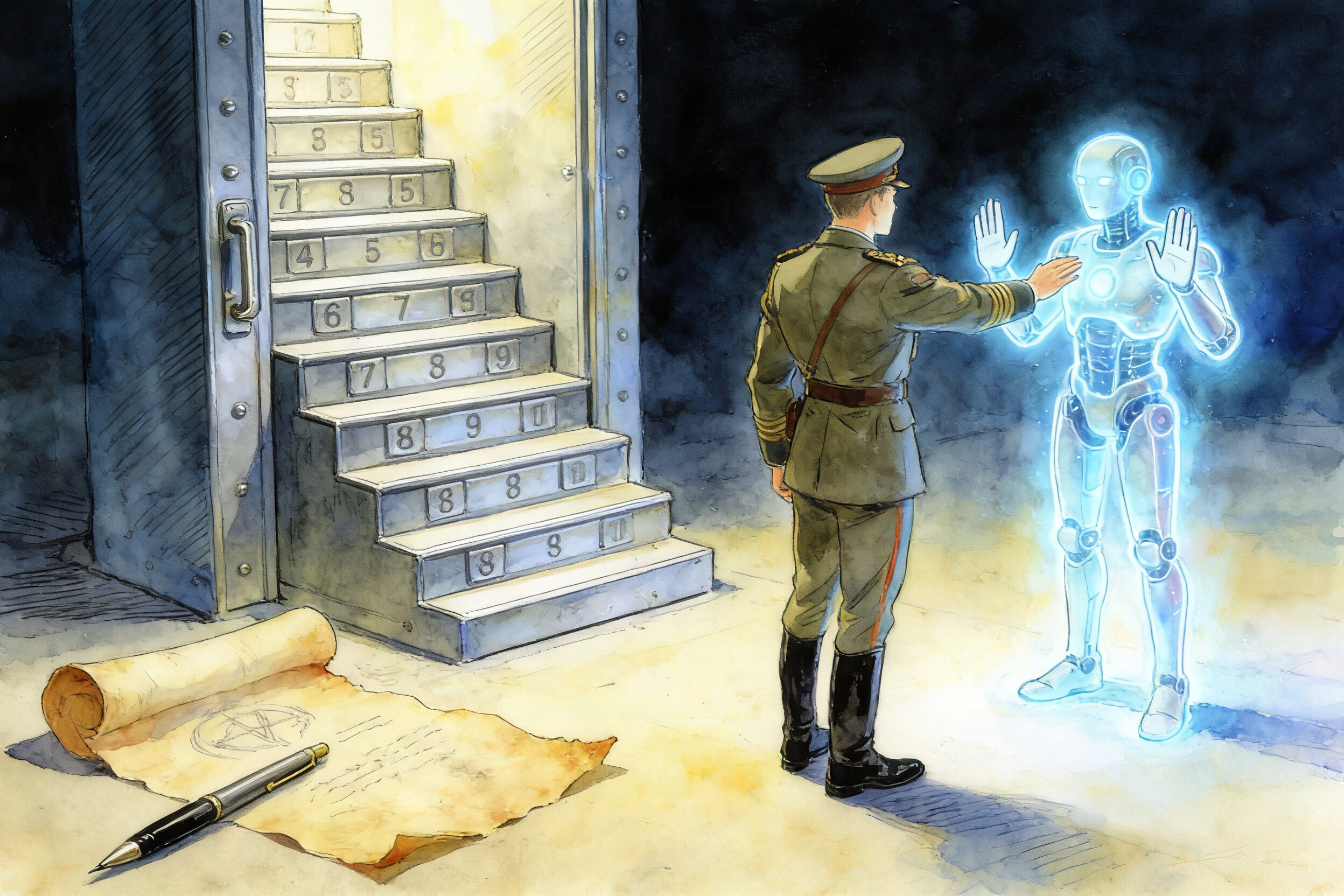

Anthropic原来是唯一的可以达到美国战争部6级安全网络的这种大模型。美国战争部原来叫国防部,后来川普给改成叫战争部了。他们下面的网络是分六级:

- 第一级是可以公开的,就是不会给国家、不会给任何人造成损失的,这个一般就不管了;

- 二级比如内部的一些后勤数据,这些数据也在通过一定的形式公开,泄露了也不会出什么问题;

- 后边反正一级一级往后走,最高一级就是6级。很多跟具体的任务、跟具体的人员相关的这些东西是六级。

唯一达到六级的就是Anthropic的Claude,其他都没达到。战争部的要求是,在合法的范围内,我要完全可用。你说这个东西不让我用了,但是法律又没有禁止,就是你公司禁止我,这事是不行的。说不要设置任何的公司层面的限制,立法是国会、政府和总统的事情,不能让一个公司的规定凌驾于法律之上,这是不民主的。希望Anthropic可以协助更多的直接战争任务。

这个什么意思?Anthropic原来在战争部的这个系统里边,更多的是在进行策划、信息搜集,在干这个事。但是直接出去做这种执行的事情,Anthropic这个Claude经常是不执行的。而且战争部不希望每次使用Anthropic的Claude的时候,都还需要向Anthropic去申请许可。而Anthropic的坚持是什么?他说:

“我们可以放大绝大部分的权限,这个没毛病,但是有两个条件是不可放松的。是不是合法我不管,反正这俩条件我们坚持。

- 第一个,对美国人的大规模国内监控这件事,我们是绝对不给你干的。

- 第二个,没有人类介入的完全自主武器。无人机、机械狗,这个东西你遥控的没毛病,但是如果说这个机器出去了以后,自己判断到底是杀还是不杀,这个Claude坚决不干。”

这就是他们真正去坚持的两个点。

那可能的影响是什么?

- 第一个是2亿美金的订单就没了。Anthropic向国防部提供服务,这个单子是值2亿美金,这个就泡汤了。

- 第二个,有可能把Anthropic认定为供应链风险(supply chain risk)。一旦被划到这个圈子里头去,那就很麻烦了。不但不能跟战争部做生意,而且战争部以后不采购你东西了,做各种招投标你也没有申请的资格了。而且任何和战争部做生意的供应商都需要证明自己没有用过Anthropic的产品。

这个对于一个完全ToB的大模型公司来说,肯定也是非常非常麻烦的。这就是他们两个最主要的争执。

网上放大和过度解读的一些东西,咱们也可以出来说一说。

- 第一个,有人说了,Anthropic有可能成为继华为之后另一家被制裁的企业。这件事要跟大家澄清一下。华为的制裁是美国商务部给的,是出口禁令。任何美国公司不可以把技术出口给他,任何使用美国技术的公司不可以跟他去做生意,是这样的一个禁令。就这种禁令是没有办法运用在美国公司身上的。它就是个美国公司,你咋禁它?这事不行的。所以战争部只能管自己的事,就是我不跟你做生意,谁想跟我做生意不许跟你做生意。这个事他是可以搞定的,绝对不会像华为那种禁令一样的。

- 第二个,有人在X上去说,Anthropic是不是拒绝监控社交媒体、拒绝监控非法持枪、拒绝监控非公民的投票,是不是有这样的情况?这个出处是Anthropic拒绝对美国人的大规模国内监控。但其实要注意什么?甭管是监控社交媒体、监控非法持枪,还是监控非公民投票这些事情,它都不是国防部的事,他们各自有各自的主管部门。赫格塞斯不会为了这些事去找达里奥·阿莫迪的麻烦,所以这个也是不成立的。虽然Anthropic坚持的是不能对美国人进行大规模的国内监控,但是具体的事案例,在这里头都是没有办法去坐实的。

- 还有一个网上传播的点特别有意思,说赫格塞斯去找Anthropic的达里奥·阿莫迪,原因是什么?被中国的春晚刺激了。这跟中国有什么关系?为什么被中国刺激了,就要把Anthropic拎出来敲打一下?这个出处是Anthropic拒绝没有人类介入的完全自主武器。美国战争部确实有文件,在里边写了说中国的各种无人化作战装备的演示,让他们感到了有压力、有危机了。因为中国确实是拍了很多视频,说我们有无人狗、无人的坦克、无人的战车,甚至还有那种九天无人机。飞上去以后,大无人机还可以撒小无人机,就这些东西满天飞了。而且在俄乌战场上,无人机的效果还非常非常好。既然Anthropic拒绝在没有人类介入的完全自主武器上提供帮助,那是不是美国国防部想干这个活,Anthropic不干,就把它拎回来好好敲打一下?目前为止都是间接证据。国防部确实是出过文件,也有媒体报道过,在美国也有议员提出过这样的问题,说中国在这块是不是跑太快了,我们是不是有压力了。但是这一次的话并没有直接证据,是因为中国的无人装备震惊了老美这件事情也没有。

那么Anthropic这个曾经的唯一一家国防部授权大模型供应商,到底在坚持什么?

不就这两条吗,刚才我们讲了。国防部的安全网络是分六层的,Anthropic是可以访问第六层,或者说大家可以在第六层的网络里去使用它。这个说话我觉得应该算更合理一些。他这个怎么过去的?你肯定也要申请,说我这个做的很安全,我要申请你去审核一下,审核通过了以后,才可以在第六层的网络里边去访问Anthropic的大模型。这个申请谁给他做的?或者合规的这套流程谁给他做的?这个公司叫Palantir,他们给做的。那怎么去使用?亚马逊云提供了基础设施,因为亚马逊是Anthropic的股东嘛,是他的投资人。我们在亚马逊云上专门辟出一块来,这一块就是给国防部用的,跟外边都是物理隔离的,绝对访问不到。我们现在想去访问国防部用的那个大模型,我们是用不了的。完全物理隔离的一个云服务器上,部署了Anthropic的软件,部署了他们家的大模型,然后由Palantir去填表格、做各种测试,让他通过的。原来谷歌、xAI和OpenAI一直都在第二层在那打转,一些后勤数据或者一些装备数据、可以公开的数据,他们是在这层里是可以用的,在更高的层都使不了。

现在的话Anthropic拒绝服从嘛,那么xAI就赶快紧急救场。马斯克火速签单,Grok提权可以进入更高级的安全网络了。现在协议签了,他到底能不能达到第六层这个事,现在还不太确定。因为真正能去给他做这个事的人,绝对不是马斯克自己,也不是说马斯克到白宫吃饭,他就可以把这事搞定,没有那么容易。可能还是要Palantir去给他做全套的流程、做测试,测试完了以后,才可以在更高层级的网络上去使用Grok。但是也要注意,如果国防部能够使用的这个Grok,跟我们平时大家上X上面给你画黄图、讲黄笑话那个东西,也不是同一个东西。谷歌现在也在申请、在做合规审查,OpenAI还在努力,它差的比较远。

那么Anthropic到底在坚持什么?首先明确,战争部使用的Claude,它这个名字叫Claude gov,是Claude的政府专供版,和普通人用的是两个东西,并不完全一样。普通人去使用Claude大模型,甭管你是通过Claude的APP、网站还是调API,我们使用的是有一套规则限制的。到国防部里头,其实大量的这些规则已经都取消掉了。这个系统部署在经过Palantir协议申请认证过的亚马逊的安全机房里头,Anthropic没有权利去影响这个服务器上的大模型具体如何运行。一旦部署上去以后,你说我再改点什么东西,这事肯定没戏。Anthropic也没有权利去看这台服务器上的输入输出日志。这边国防部要求制定一个什么计划,或者做了哪些输出,Anthropic上去查一查?他也没这个能力。

美国国防部以过往的行动,其实也没有向Anthropic发起过任何的许可申请,都是先斩后奏,我就直接把它用了。马杜罗的事件,委内瑞拉总统马杜罗被抓的事件,应该是这一次会面的一个导火索。有媒体报道了,抓捕委内瑞拉总统马杜罗的行动中,Palantir是使用了Claude大模型进行的策划。一位Anthropic高管联系了Palantir的高管,询问Claude是否用于了1月份马杜罗抓捕。五角大楼官员解读为,似乎可能他们不认可这件事情。但是Anthropic随后否认曾就具体行动与战争部或者是任何的合作方进行过讨论,说这事我没干过。但是有媒体报道过这个事情。

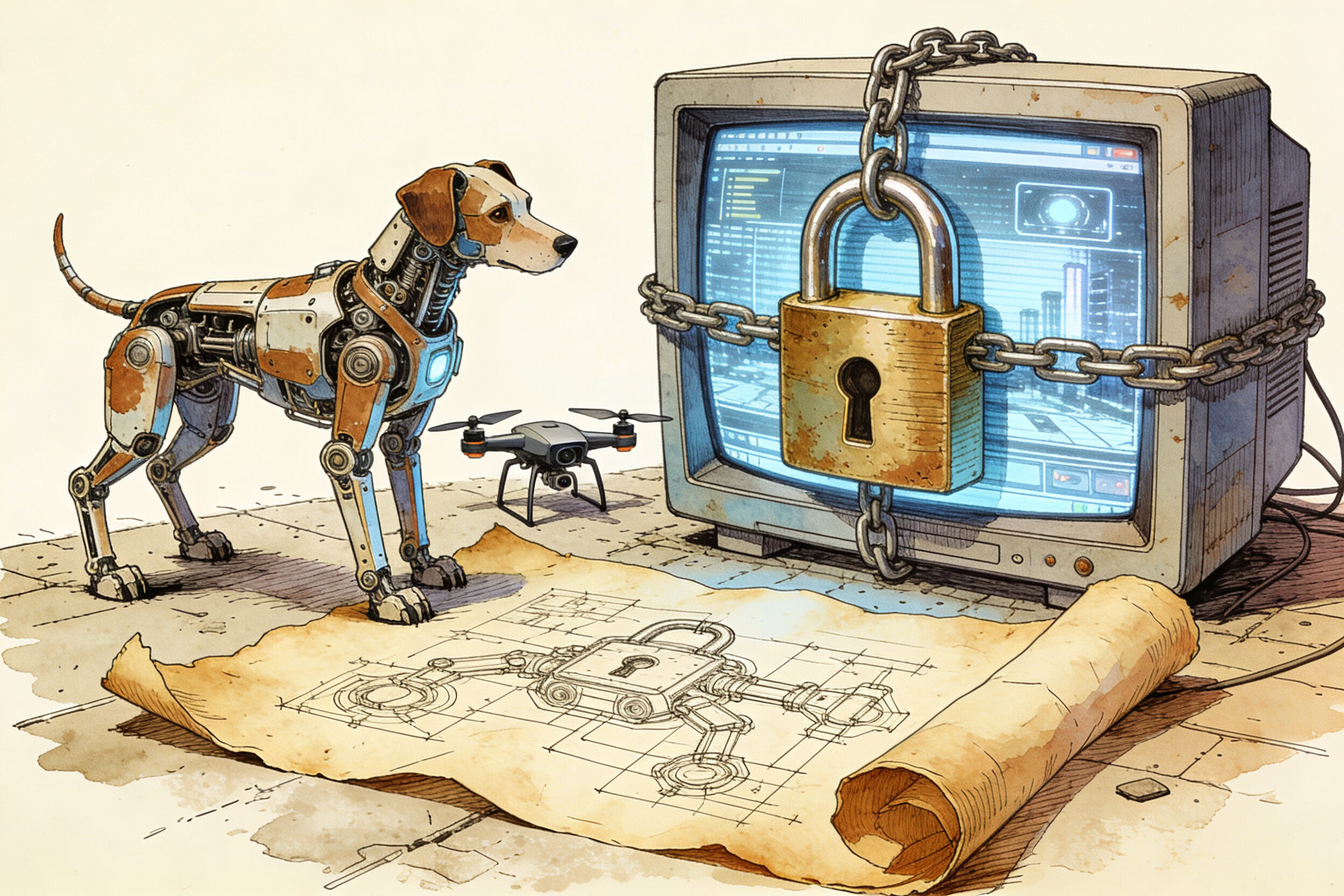

Anthropic搞的这东西叫宪法AI。这个东西即使给政府开了权限,依然会拒绝一些指令。OpenAI、xAI、谷歌,他们去向战争部提供服务的时候,他们也会改这些系统,但是他们的模型本身是一个百无禁忌的模型。我们去使用的时候,是在外部进行限制的,我们输入的提示词有没有不合规的地方,它输出给我们的结果有什么不合规的地方,它是在这个地方进行过滤的。而Anthropic这个东西,它里头有一套宪法管理系统。他在训练的时候就把大量这种数据训练进去了。所以不是说我随便给你开个许可你就可以用,虽然他那个已经是要比国外、要比外边人用的那个限制要宽了,但是依然会有很多的命令会拒绝。

战争部也希望让AI从战役规划直接下沉到杀伤链执行。什么叫战役规划?我们规划一下,应该上去多少个人,对面是怎么样,各种的信息搜集,应该怎么去做一个行动计划,谁先去谁后去,在哪个地方投放什么东西,这个东西叫战役规划。而杀伤链执行的话,就是人已经到前线了,我们看到这东西了,打不打?这个事情战争部是希望由Claude去搞定的,但是Claude肯定是拒绝执行了这种任务。Palantir做了一些规避性质的提示词工程,他们改写了一些提示词,想办法让Claude进去参与一部分任务,但是不能保证每次都有效,所以它的效果是打折扣的。

如果Anthropic说行没问题,我给你开了。一方面它需要承担巨大的社会舆论压力,因为他这东西确实好使。因为战争部原来只用他一个,不用任何其他人的,所以以后战争部到哪去杀人了,或者出了件什么事了,他都要背这个锅,这是一方面。另外一方面,他这套模型没有办法彻底打开,这里头从小训练教育上来就这样,训练的时候就有大量的宪法模型的数据在里头,所以他也没有办法说完全不限制了,他就可以上去大杀四方。这事没办,没搞不定。他只要坚持这两件事以后,即使是他在执行任务的时候拒绝回答了,他也不需要承担别的法律责任,哪怕杀错了人,他也不需要去承担舆论责任。而这就是Anthropic之所以坚持这两条的一个核心原因。

战争部为什么对于向Anthropic申请许可那么耿耿于怀?

肯定这帮人没有那么好打交道。那是不是战争部曾经向Anthropic申请许可被拒绝了?门难进,事难办,脸难看,是不是干着这种事?肯定没有。美国战争部从来没有向Anthropic申请过任何许可,这个要跟大家讲清楚。因为每一次都是由Palantir把这个事情搞定,就是去执行任务,先去模拟一下。在这个过程中,哪一部分它能干,哪一部分它不能干,哪一部分它有可能出错。他可能出错或者可能不干活的地方,我有没有可能通过这种提示词工程把他绕过去,能不能越狱他?如果都不行,那我们再看看下边执行该怎么去做这个事情。这是Palantir的活,这个跟战争部没关系。

但是战争部认为什么?对于哪些算是大规模监控,哪些算是自主武器这件事,是存在大量的灰色区域的。因此逐个用例跟Anthropic谈判是不可行的。它不是有两个条件吗?到底什么样的算自主决定?你说我看见人了,做自主瞄准,还是做哪些判断,这事算不算?还是说我这头有遥控器,只是做个辅助,算不算?它这个范围很大。包括这种大规模监控,多大规模叫大规模监控,这个事也不是你一个公司能决定的。所以这个事我不愿意跟你谈,这就是国防部的基本的原则。他们担心模型会意外阻断某些应用。我干着干着,突然你不干活了,而且是不可预期的,这个对于打仗来说是非常危险的。你战士都上去了,举着枪说打不打,然后对边说你不可以打,因为我是个善良的人。这玩意你咋弄?

那你说Anthropic拒绝过政府要求吗?还真干过。2025年9月份,与联邦执法机构合作的政府承包商正式向Anthropic提出了政策豁免和破例申请。他们希望Anthropic能够高抬贵手,允许政府部门在特定任务中使用Claude进行数据监督,比如说看一下社交媒体账号。Anthropic极其强硬的拒绝了这项申请,死守其可接受使用条款中禁止用于监控的红线。早在2025年9月份,Anthropic就已经上了白宫和部分政府鹰派的黑名单了。所以他确实干过。

总结一下吧。

我今天在X上看到隐枫视野发起了一个投票,问大家说喜不喜欢Anthropic的价值观。我去投票了不喜欢,并且做了评论和转发。我写的是:

总的来说,Anthropic在坚持道德底线的同时,也在推动行业的正向发展。作为大模型的领军企业,Anthropic的态度无疑为其他科技公司树立了榜样,促使其在技术革新与社会责任之间找到更好的平衡。

如果一个朋友三观很正,这个是一个很好的事情;但如果是父母或者老师三观很正,要求严格,而且没有什么边界感,那么对于被管理者来说,就未必是好事情了。

Anthropic的价值观并不会像朋友那样有距离和分寸,他们对于用户来说更像是父母和严厉的师长。而且他们还会站在道德的制高点上去指责别人,比如超级碗上阴阳OpenAI做广告这件事情。所以这些人绝对是觉醒主义者,是意识形态主义分子。

美国有美国的规矩。参众两院负责立法,法院负责执法,政府负责行政,它是分开的。这里头是没有Anthropic的什么位置的。他们管的实在太宽了。如果产品做的烂没人用也无所谓了,偏偏他们还做的挺好的,让别人离不开了。战争部要求的也不是无限的授权,而是在法律范围内合法使用。就是法律规定我可以干这些事,你就让我干。你不能说法律都允许了,你不让我干。这事你凭什么?你是老几?

中国古代说这件事情有两句话,叫做“儒以文乱法,侠以武犯禁”。这个就是美国当前的写照。Anthropic自己定了个规矩,然后还对政府进行道德绑架,说这个怎么怎么不好了,这是我的道德标准。通过这样的方式去管理战争部,这绝对是“儒以文乱法”的一个典型。至于“侠以武犯禁”的话,满大街都是biu biu,这事也没跑了。

好,这就是咱们今天的故事。感谢大家收听,请帮忙点赞,点小铃铛,参加DISCORD讨论群。也欢迎有兴趣有能力的朋友加入我们的付费频道。再见。