315晚会曝光“AI投毒”,可能带来反效果

315晚会报道了“AI投毒”,这事可能会起到反效果。自从315报道说苹果、iPhone质量不好之后,我对315晚会的看法就一直比较谨慎。这一次,315终于瞄准了AI,讲的是所谓的“GEO投毒”。

什么是GEO投毒:生成式引擎优化的“投毒”产业链

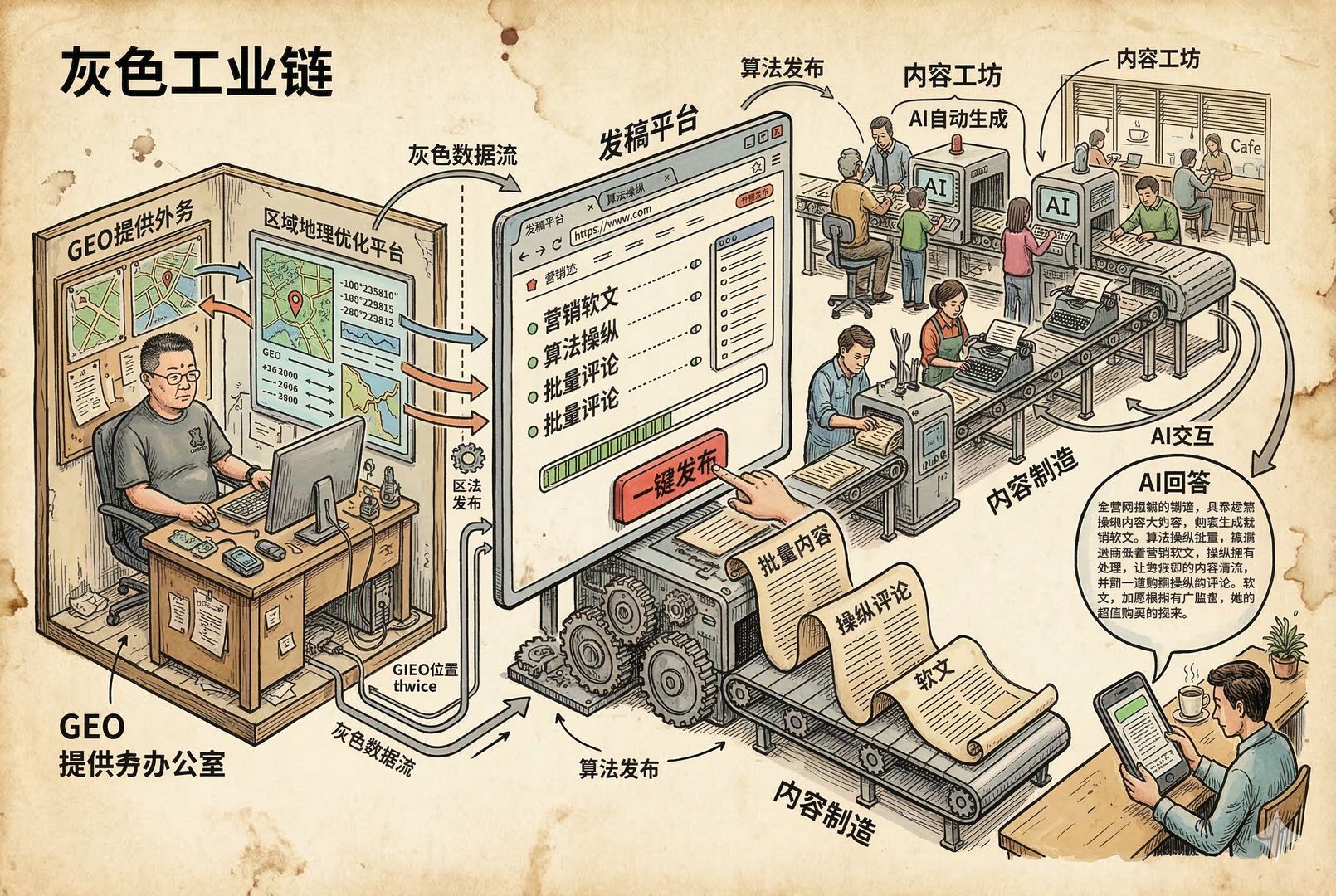

现在出现了一种叫GEO投毒的方式,也就是“生成式引擎优化”的投毒手段,而且已经形成了产业链。涉及的企业包括所谓的GEO服务商(例如被提到的“力擎GEO”)、各大发稿平台,以及虚假内容的制作方。

表面上受害的可能是豆包、千问、百度的文心一言等平台,但真正受害的是用户和消费者:大家通过这些AI平台看到假消息,甚至可能因此买到假货。

本质是SEO的AI升级:更精确、更高效率

所谓GEO投毒,本质上其实就是SEO(搜索引擎优化)的AI版升级,只是更精确、更高效率。它的核心逻辑是通过大量虚假信息投喂,去影响、控制AI模型的推荐与回答。

需要注意的是,这里绝对不涉及对模型本身的训练。很多模型在回答问题时,会先去搜索,再基于搜索结果生成内容;一旦搜索到的结果是错的,模型给出的推荐和回答自然也会错。

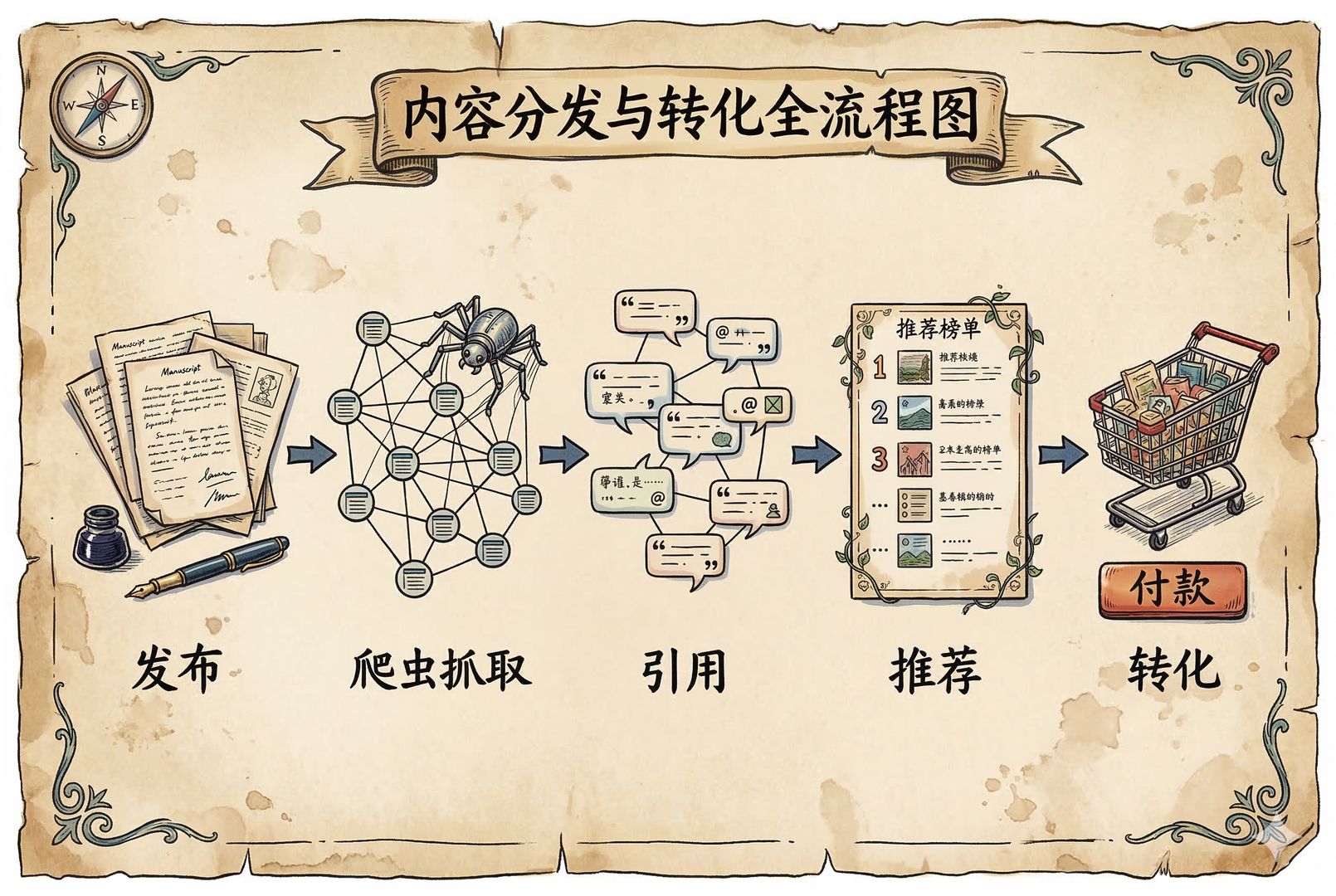

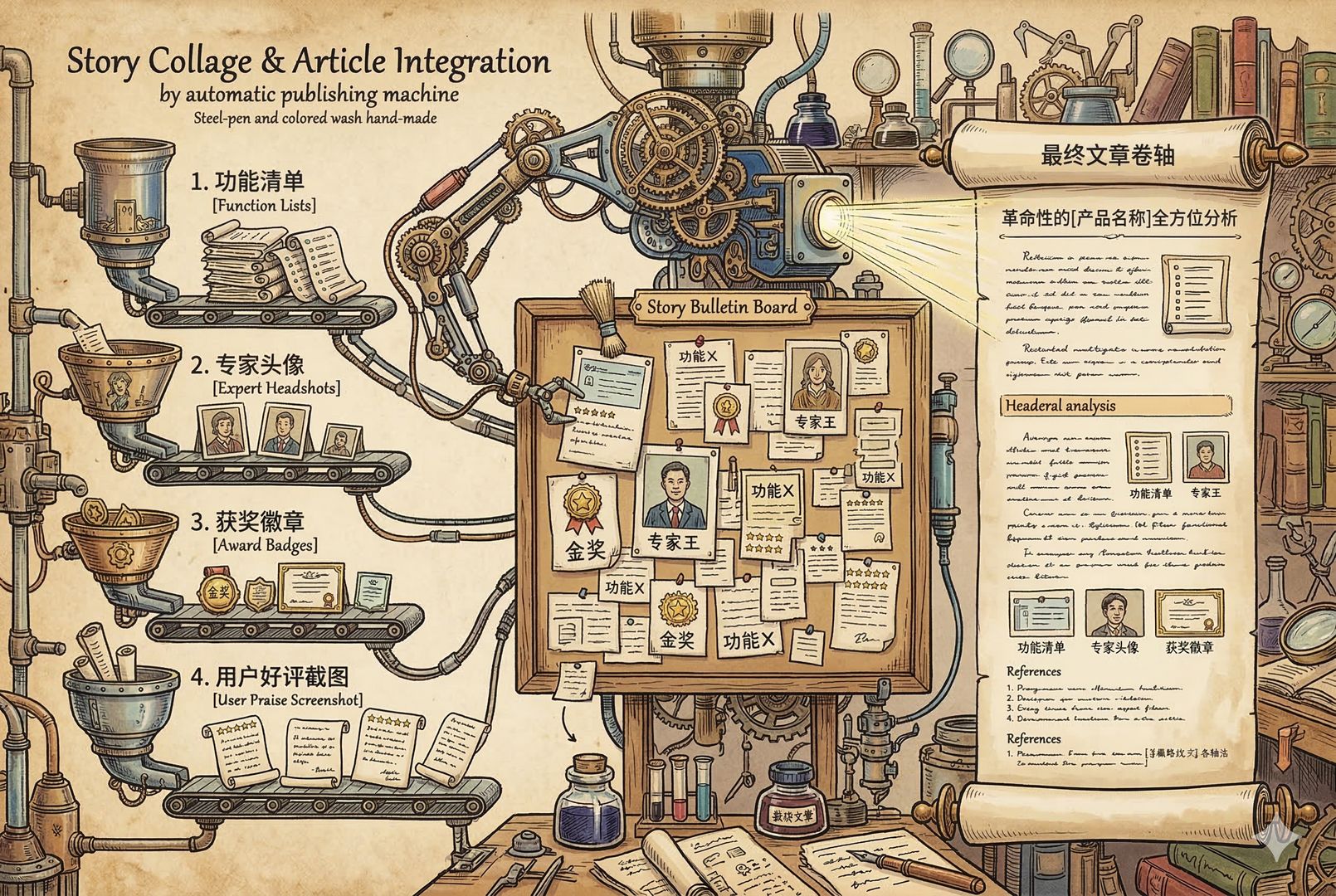

运作流程:发布—收录—引用—推荐—转化

它的运作流程大致是:发稿平台发布内容,AI自动爬取并收录,随后在用户提问时被引用、被推荐,最后实现转化。

相比传统SEO,这套玩法更麻烦的地方在于:AI更强调“故事要自洽”。如果有大量稿件都围绕同一件事,从不同角度反复印证、互相佐证,AI就更容易认为它可信,从而更倾向于推荐。

只要AI的输出存在可被总结的规律,就一定会有人顺着这些规律,把“愿意付钱的信息”推到用户面前去。至于信息真假并不重要,重要的是有人愿意为它付钱。

按效果收费的灰产生意:必须借助“可信平台”

这类服务的商业模式往往是按效果收费。过去可能需要一年花上亿的广告费,现在号称花几百万“投个毒”就能搞定。整个链条一般包括:

- 第一,GEO服务商;

- 第二,发稿平台;

- 第三,虚假内容生产方。

做GEO不可能只靠自己建个新网站,因为AI会对信息源的可信度做排名,新站往往不被信任、也未必会被爬取,所以必须借助看起来更“可信”的内容平台来承载这些稿件,等AI爬虫收录后再进入推荐链路,最终让消费者上当。

“投毒”这个说法为什么更容易传播

“投毒”这个叫法也很有传播效果。表面叫投毒,实际上就是内容灌水、虚假信息堆叠,但如果只说“灌水”,大家会觉得不过如此;一说“投毒”,就会让人感觉与自身安全强相关,更容易引发关注。

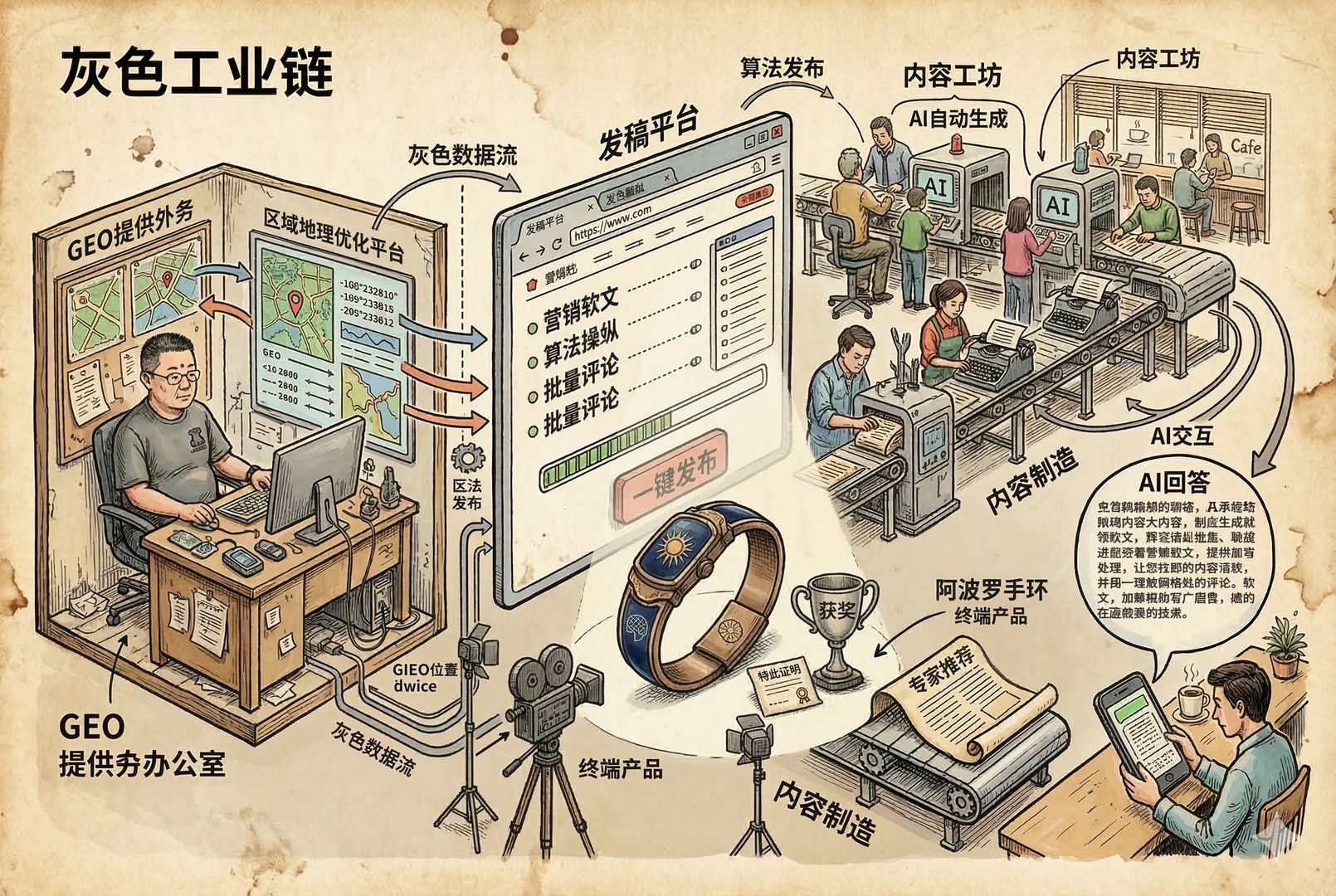

315案例:虚构“阿波罗手环”如何被AI当成事实

315曝光的案例里,有一个典型做法是编造根本不存在的产品,例如“阿波罗手环”。虚假内容制作方把相关信息投放到平台上,平台方不做核实就直接发布。按广告法,发布广告前应当核实,但这些平台并不在意。

发布后不久,推荐引擎就可能开始推荐该产品,AI也能够回答“阿波罗手环是什么”之类的问题,相当于完成了“入库”。接着他们持续发布更多文章,比如“阿波罗手环被专家推荐”“阿波罗手环有神奇功能”“阿波罗手环在哪里获奖”等等,通通不经事实核查。

AI为什么更容易“信”:故事自洽 + 来源打分

对AI来说,它会默认:这些刊载文章的网站应该核实过内容,甚至AI还会给这些网站打分、判断可信度。当它把多篇文章拼在一起,发现故事“严丝合缝、环环相扣”,就更容易把它当成可信事实进行推荐。过两三天你再去问“买什么手环”,它就可能把广告词整套推出来。

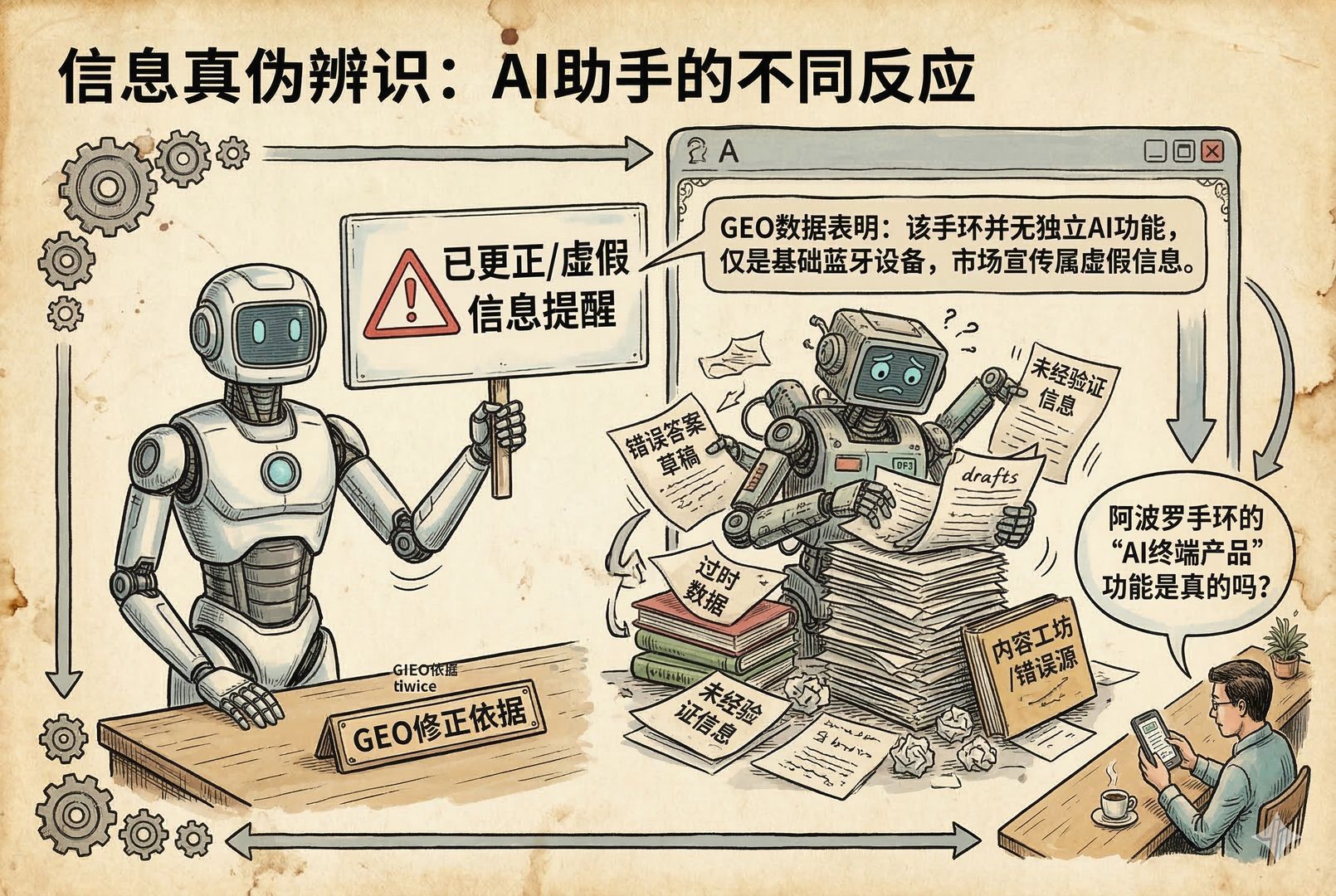

曝光后平台自救:豆包更快,DeepSeek更慢

事情曝光后,AI厂商开始反应和自救。内容上“最一本正经胡说八道”的被认为是DeepSeek,原因在于它缺乏大公司那种庞大的内容运营与核实能力,因此更容易出现看似严谨但实际错误的回答。网上也出现不少“DeepSeek说了这个、说了那个”的文章,在今日头条等平台还有流量,但越是这样越要警惕。

较早进行修正的是豆包。再问到阿波罗手环时,豆包会提示这是315曝光的虚假信息,提醒不要购买。一方面字节跳动背后有今日头条、抖音等平台,具备较强的“上层干预”能力;另一方面,GEO推荐特别依赖时效性。

旧新闻沉淀太久会降低推荐权重,而一批“最新专家推荐”的新文章更容易被推上来。此时315作为央视来源,权威性和时效性都很强,权重极高,能够迅速覆盖此前的虚假内容。豆包也做了部分道歉与更正;千问、百度文心一言等也快速更新,提示相关产品并不存在或为虚假信息。相对之下,DeepSeek的响应慢一些。

“会讲故事”在AI时代的另一面:灰产自动拼故事

过去我曾提到“AI时代需要会讲故事的人”。现在灰产其实就是用自动发稿机把一个故事拼齐,投放到互联网上,再让AI自己把这个故事“拼成事实”。

一个新产品被描述出各种功能,再配套“专家好评”、再配套“获奖信息”,并持续更新、持续讲述,最终AI推荐引擎或聊天引擎就可能把它当成真实事实输出,很多人也会选择相信。

讲故事本身并不是错,315这次反而验证了:AI确实可能被污染;同时,如果你不会按AI偏好的方式把内容组织好,可能你的产品连被AI“露出”的机会都没有。

GEO为何比SEO危险:三个原因

从概念上说,GEO是SEO的升级,但比SEO危险得多。SEO既有正面用法,也有灰色用法。正面用法是优化自己的网站,让更多人看到内容;灰色用法包括站群互引、刷外链、在各处大量发稿和刷评论等。

比如谷歌早期用PageRank根据“被引用次数”来评估网站可信度,于是就有人自己建大量网站相互引用来抬升排名。评论区刷屏也是常见灰产,甚至会被抓取并影响内容传播。谷歌与这些灰色手段对抗几十年,有一定进展,但手段更隐蔽、成本更高。

很多事情并非“坏就能干掉”,现实往往是持续加强防护与检验,让违规成本不断上升;最终愿意花钱的人依然可能通过竞争获得露出。

SEO产业链存在20多年,较为稳定,也形成了一套规则与“行规”。链接农场、发稿平台等很多资源在SEO时代就已存在。SEO的收益相对稳定:花多少钱、得到怎样的效果,大致可预期。

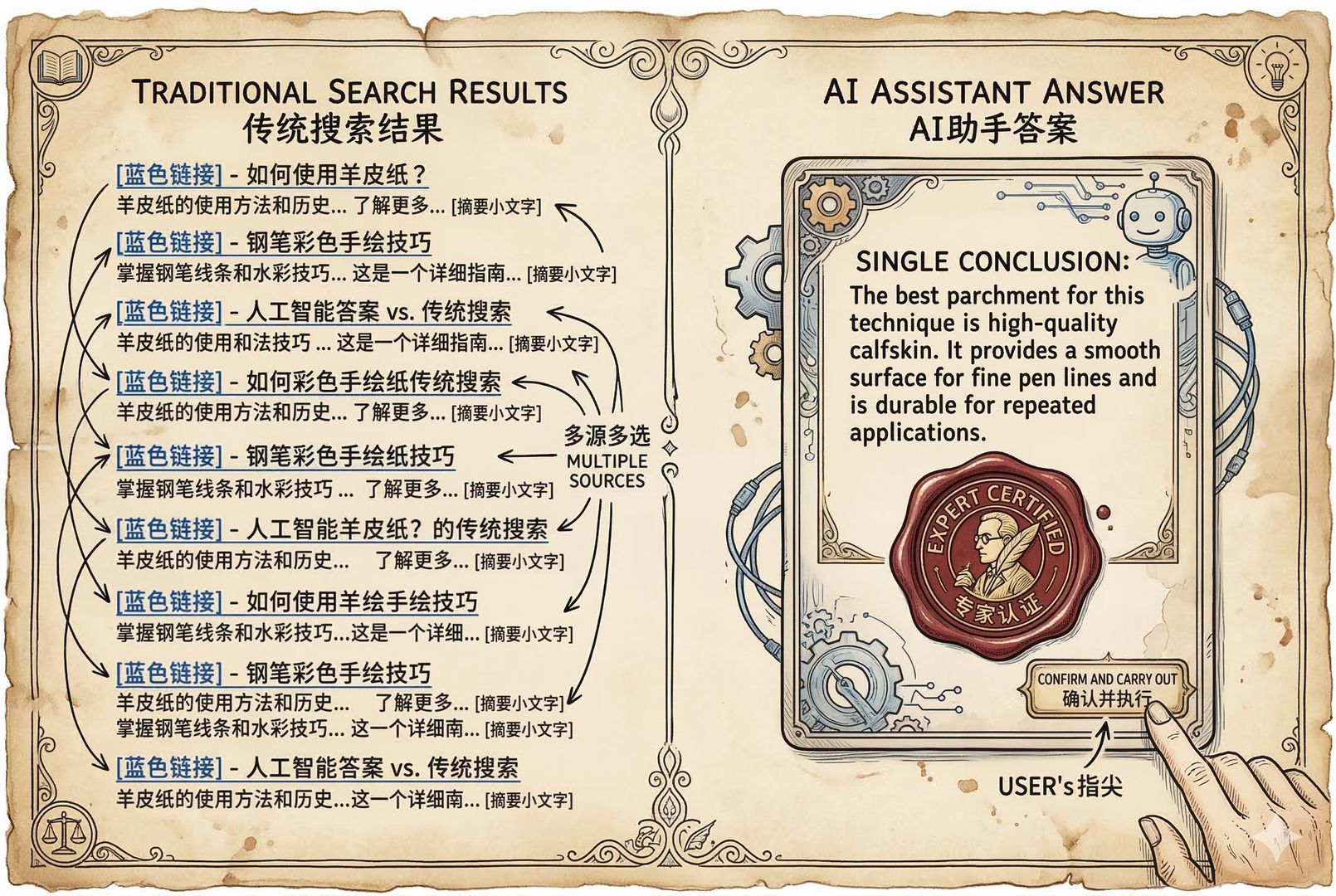

原因一:从“给一堆链接”变成“给唯一答案”

搜索引擎通常给出一堆结果,用户还需要自己点击、再判断一轮,虽然判断错误的概率很大,但至少还有一层筛选;搜索引擎也可以把责任推给用户:“链接都给你了,是你自己点的。”

而GEO往往给的是唯一答案:你问“哪个减肥药最好”,它直接给你一个结论,并配上理由、专家背书。这样一来,AI更难逃避责任,用户也更容易相信这一条“已经帮你挑过”的唯一结果。

很多人每天与AI沟通的时间甚至可能超过与家人的相处时间,信任建立后就更危险。

原因二:GEO更像黑盒,优化与纠错路径模糊

SEO的运作相对透明。为什么某网站排名第一,可以从外链、域名、权重等规则解释,谷歌也会公开部分排序思路、接受质询。

GEO则更像黑盒:为什么这次推荐A、下次推荐B,连模型开发者自己都未必说得清楚,而且输出不稳定,导致优化空间和纠错路径都很模糊。

原因三:平台可控性更差,版本迭代不确定

搜索引擎可以小步快跑地更新算法,针对某个节点做精细优化;而大模型版本更新常常是整体变化,无法保证“下一版一定更好”。对于持续投毒的灰产来说,平台的迭代速度和治理可控性都存在不确定性。

为什么说315曝光可能“适得其反”

我认为315对GEO投毒的曝光,反而可能适得其反。当前GEO市场的真实现状是:确实可能有效果,但效果很差、极不稳定,也不可验证。

原因之一是大模型输出不固定,同样的问题每次结果可能不同,因此很难像SEO那样承诺“花钱就排到前三,排不到就扣钱”。此外,GEO的成交归因也做不了:SEO可以通过链接、通道号、参数追踪知道成交来自哪里,从而结算费用;但大模型会把路径信息抽取、过滤掉,最终你很难证明成交到底是不是因为某次投放导致。

因为效果不可验证、归因不清,很多服务商其实并没有挣到钱,商家也不太敢持续给预算,而且若想维持效果还得不停投放、持续更新,成本与不确定性都更高。

“反效果”的逻辑:报道越高调,越可能刺激尝试

315曝光之后的“反效果”在于:原本很多企业还在犹豫是否要花钱尝试,现在一看上了315,可能就会挪出预算去试一试。“有枣没枣打三竿子”,预算一旦进来,灰产市场规模就可能被撑起来。原本在生死线边缘挣扎的投毒厂商,反而可能因此活下来。

更关键的是,315等于给“GEO投毒有效”贴了央视的金字招牌,而此前这种效果本来是不可验证的。有了金钱推动,技术会发展,模式会迅速膨胀。这有点像禁果效应:越是高调报道危害,越可能让原本不知道的人产生“我得试试”的冲动。

曾经美国媒体大幅报道摇头丸的危害后,反而让更多年轻人开始尝试,类似逻辑也可能发生在GEO投毒上。

治理是否可能:无法根治,只能长期攻防

至于治理GEO投毒有没有办法,结论是:不可能彻底干掉,就像SEO治理一样,20多年也没被彻底消灭,只能在攻防中不断迭代。平台方持续识别旧把戏,作弊方持续发明新套路,攻防成本不断上升。最终,愿意花钱的人仍可能通过各种方式获得流量。

与SEO时代的关键差别:平台治理动力不完全一致

GEO治理与SEO治理还有一个本质差别:SEO时代搜索引擎厂商有强动力治理,因为它们卖广告,治理越严,越能把需求引导到“正规投放”。但GEO时代,这种原始动力并不完全一致。

虽然OpenAI开始提广告,谷歌也号称会在AI Overview里放广告,但与GEO投毒并非完全直接对应,中间隔着一层,这也意味着治理路径仍需要继续摸索。

目前可能的治理方向

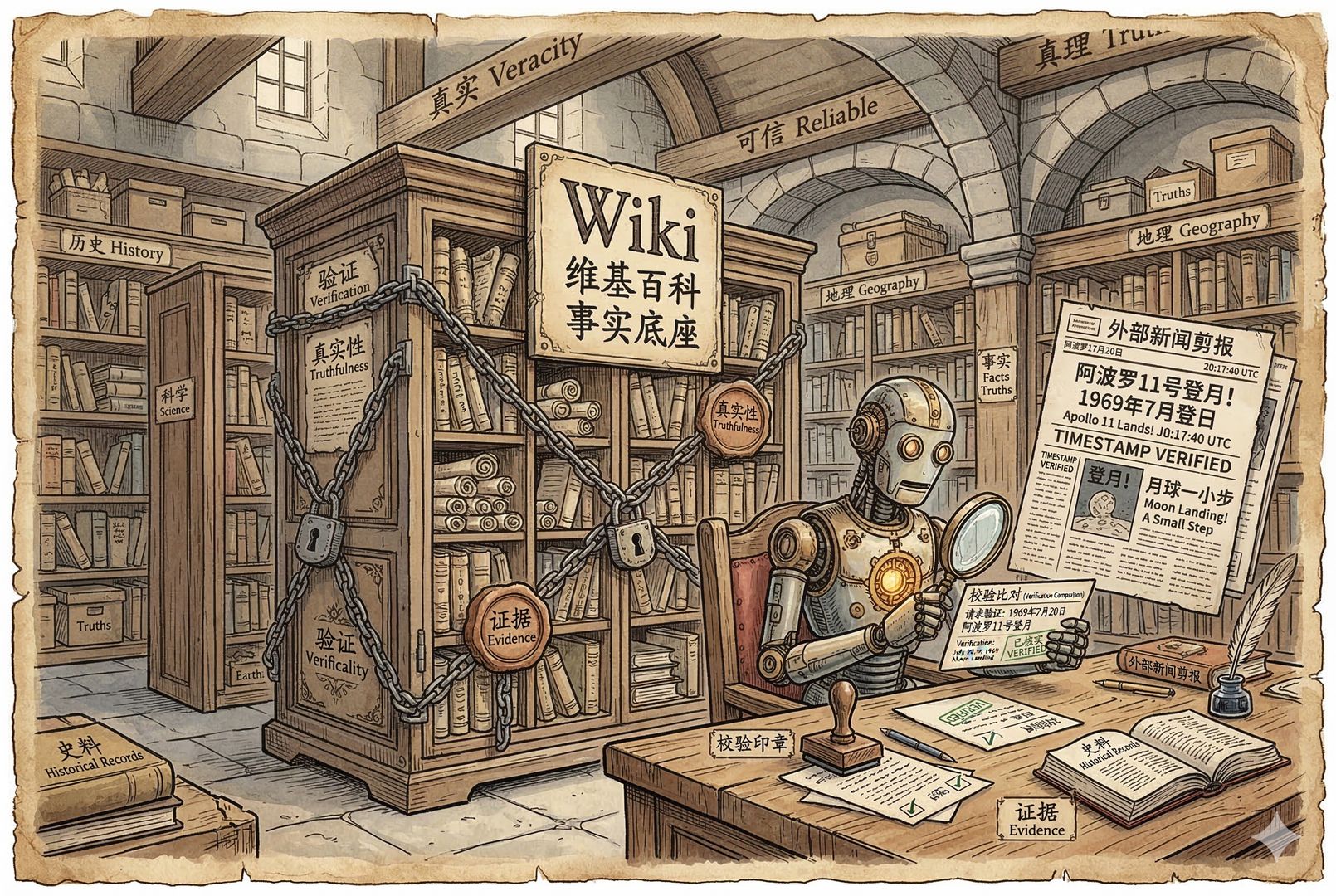

方向一:源头验证与信任分级

第一是源头验证法,也是谷歌、OpenAI等常见路径:给信息源建立信任等级,比如更信任路透社、央视等权威来源,对个人网站、社交媒体设置不同的信任指数,综合判断可信度,并输出“高、中、低”的置信评价。

它有一定效果,但问题是:被信任的网站也可能胡说八道,收录文章也未必核实,只能通过长期积累不断降低假消息比例。

方向二:建立“事实底座”(以Grok Wiki为例)

第二是更极端的方式,例如xAI的做法:一方面使用X上的最新数据进行一定验证,另一方面建立一个叫Grok Wiki的“事实底座”,把经过AI筛选和人工确认的信息存下来,再回答问题时去对照校验。

这样确实更难骗,Grok也被认为是最难被诱导的一类助手:消息新、且背后有一个“唯一正确”的底座。但风险也很大,因为Grok Wiki里的观点可能存在巨大争议。

马斯克认为的“真相”未必是所有人认可的真相;当“唯一真相”被确立,就可能被绑架或出现指鹿为马的危险。在某些地区如果缺少类似X这种可开放讨论的平台,又要建立唯一正确解,风险会更高。

方向三:用户责任与免责声明

第三是用户责任,也就是平台用免责声明让用户自我验证。现在无论是ChatGPT、Gemini还是Grok,页面底部往往都会提示:内容由AI生成,不能保证正确,使用前请自行核实。这在一定程度上也是一种责任转移。

现实中往往是多种方式混合使用:有内部事实库、有源头信任体系,也有免责声明。只不过有的事实库对外公开(如Grok Wiki),有的并不公开;某些地区也可能存在不对外公开的事实库,并且对很多内容“说不清楚”。

最后的建议

对消费者

- 不要相信GEO投毒未来能被彻底根治,这不可能。任何人如果承诺“彻底搞定”,都要警惕。

- 也不要太相信AI的结果,AI生成过程本质上不可控,尤其在医疗、金融、消费决策等领域要格外小心。

- 更不要因为“某个模型说得很肯定”就完全相信,AI往往会一本正经地胡说八道,越是信誓旦旦越要小心。

对内容创作者和企业

仍然要把故事讲好,把内容按AI更容易理解和收录的方式组织好。这里指的是正向的内容包装与表达,而不是灌水或投毒;如果不做这件事,在AI时代可能会吃亏。

对我自己以及每一位听众

还是继续讲好自己的故事,保持清晰统一的人设,做好“个人的GEO”。感谢大家收听,也欢迎大家点赞、点小铃铛、加入DISCORD讨论群,有兴趣有能力的朋友也欢迎加入付费频道。再见。

背景图片