文科生到底是如何用中文玩转 Vibe Coding 的?这是范太太的亲历分享。

大家好,欢迎收听老范讲故事的 YouTube 频道。

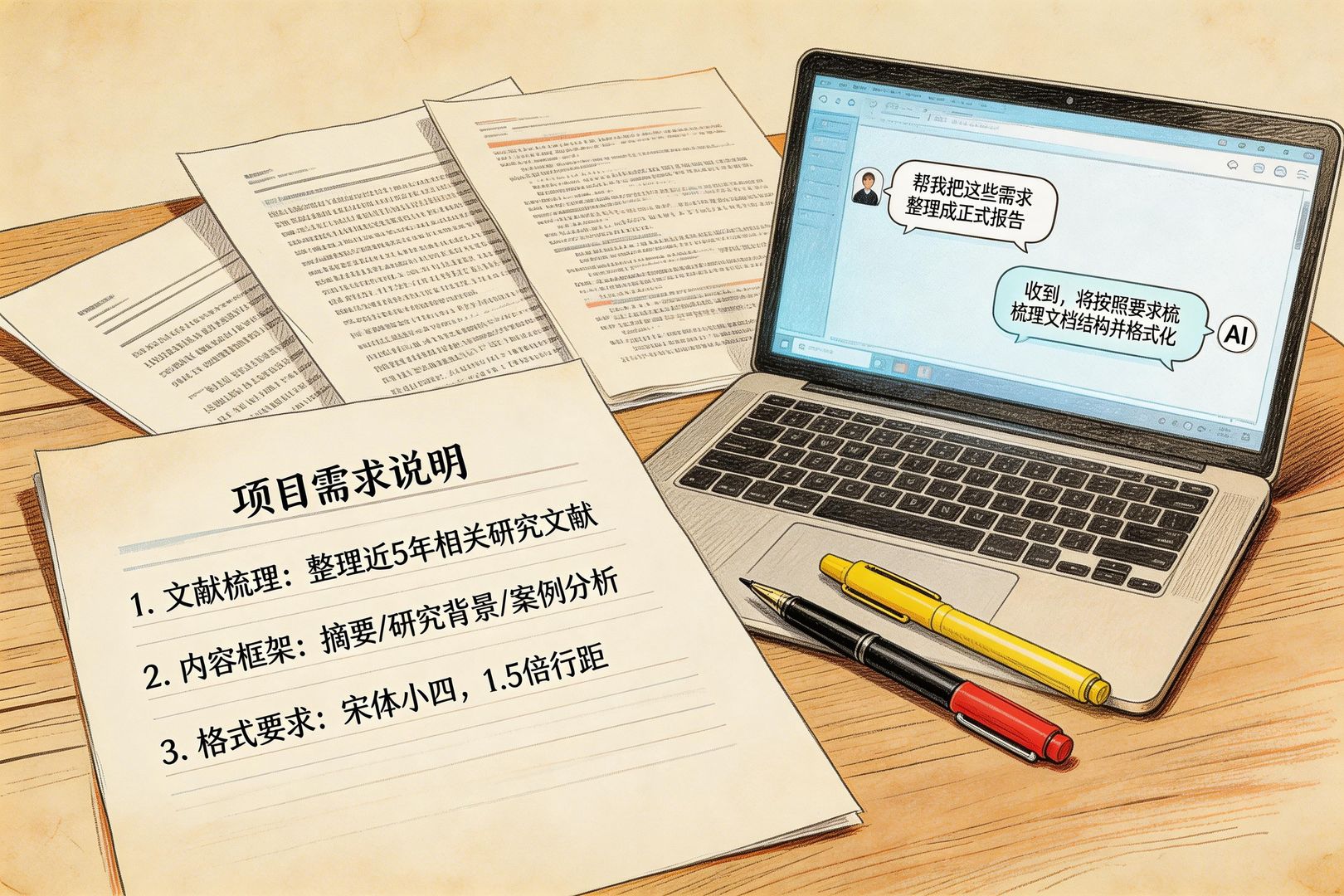

Vibe Coding 并不一定需要写代码。范太太是一位英语老师,她终于决定自己上手 Vibe Coding 了。她做的事情是:在 Word 文档里用中文描述需求,输入 PDF 和 Word 文档,然后输出归纳整理后的 Word 文档。

这类繁琐的信息汇总、翻译、校对工作,绝对不是什么一键就可以搞定的事情。范太太也没有成为什么 Vibe Coding 大师,但是她觉得投入产出比已经为正了,确实节省了大量时间。

今天老范站在程序员的角度,和大家分享一下这个过程。对于程序员来说,我们可以借此学习文科生思考问题的方式,以后如果要为他们服务,应该如何下手。对于文科生来说,Vibe Coding 已经可以上手干活了,不需要学习编程,但有些思维方式还是要转变,有些坑也需要绕过。

今天的内容分成五部分

今天这个故事分成五段来讲:

- 先描述一下项目,到底干了一个什么活;

- 文科生开始 Vibe Coding 之路必须经历的 5 个坑;

- 从程序员的角度描述一下 AI 到底是怎么干活的;

- 当文科生都可以用自然语言,透过龙虾或者 Codex 这样的工具解决问题时,世界会变成什么样;

- 最后,不管你是工程师还是文科生,我们到底应该怎么办。