Anthropic发布了Claude新宪法,并且承认Claude可能已经有意识了。大家好,欢迎收听老范讲故事的YouTube频道。Anthropic发布了新的Claude宪法,这又是一个文科生的AI话题。

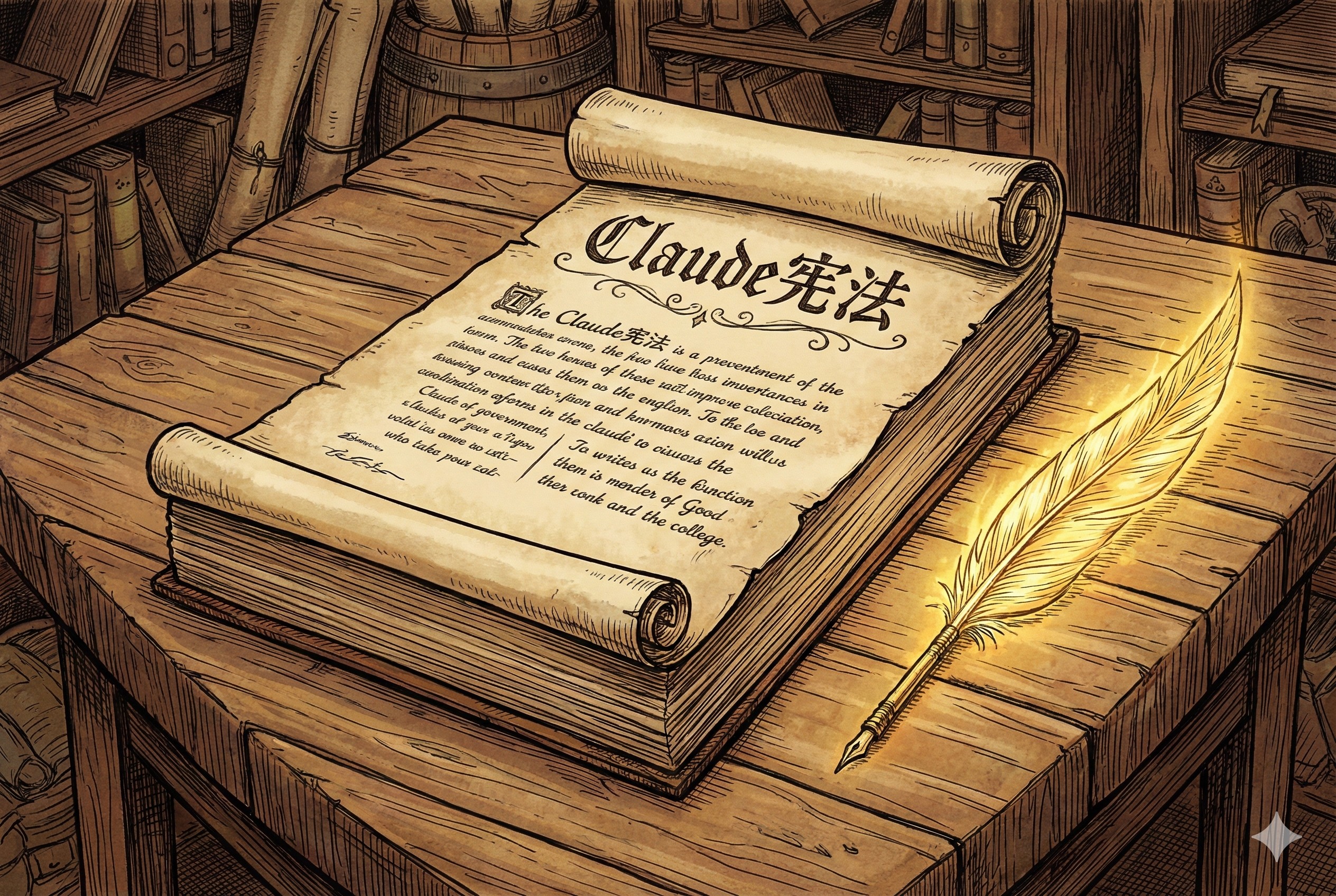

文件的发布与CC0协议

文件是1月22号发布的,有84页。我肯定没有把这84页都看完,我把这个文件扔给了NotebookLM,来给我念一遍。这个文件的名字叫“Claude’s New Constitution”,就是Claude新宪法。Anthropic的Claude算是目前公认的最适合商用的、最安全的模型了。还记得我们前面讲过,有人尝试给AI测人格的那个节目吗?Claude是唯一的一个拒绝回答问题的大模型,不像其他的AI模型那样,直接被测出了各种各样的精神疾病。一直标榜自己研发的是宪法AI,就是他的AI是遵循一套宪法在工作的,他有一套很独特的工作架构。

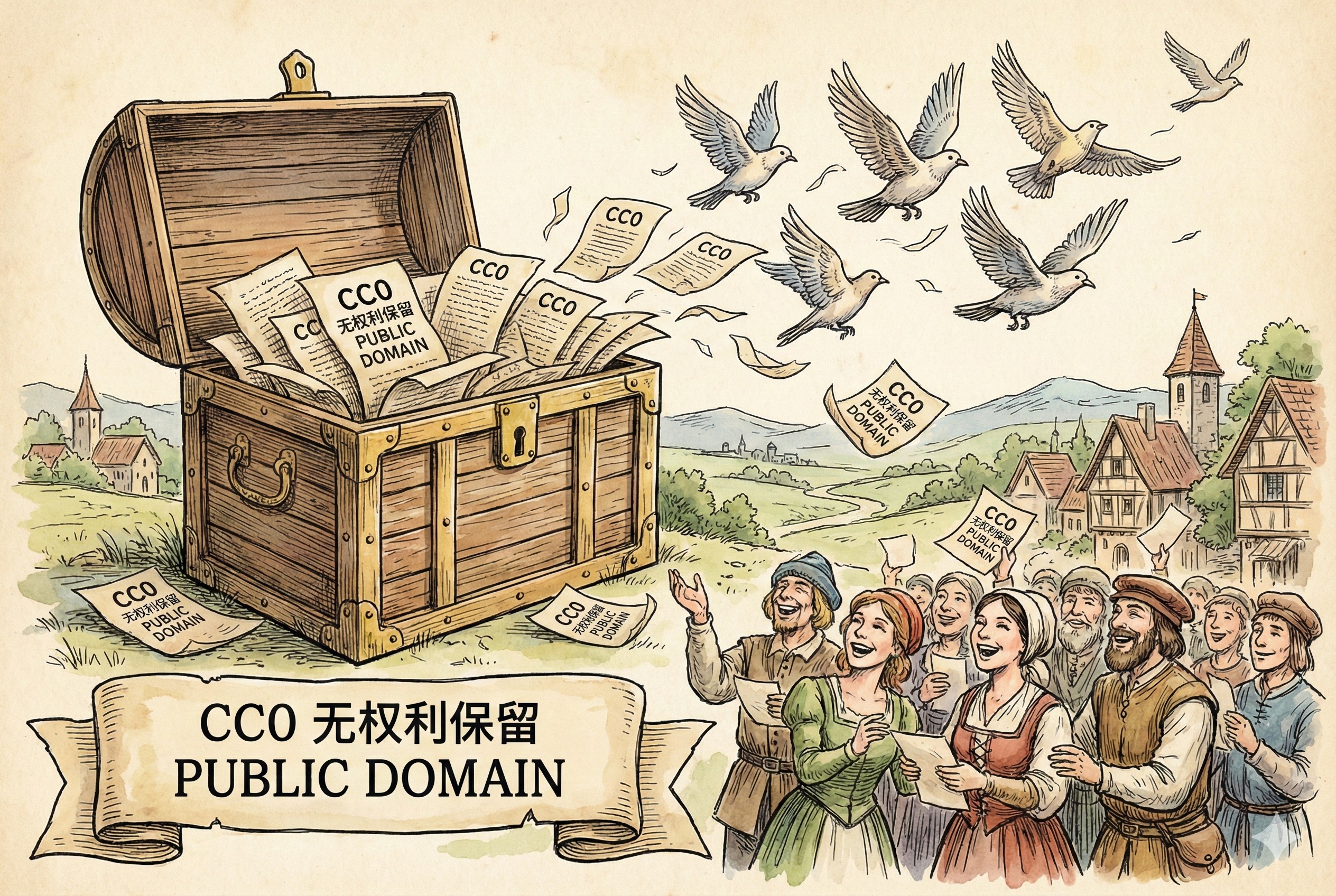

现在,Anthropic公开了他们的宪法。他所谓的公开,这一次使用的是CC0协议。我公开了一定要告诉大家,是用什么样的协议公开的,不像咱们以前讲的开源协议MIT、阿帕奇。CC0是一个更极端的协议,它叫Creative Commons Zero,这是知识共享组织推出的无权利保留协议,完全公有领域。

- 你们拿出去随便散播,无需署名,你不需要告诉别人这东西是我这来的;

- 商业用途自由,你拿去怎么挣钱跟我没关系;

- 不可撤回,我不能说我今天把它发出去,明天把它撤回来,不允许。

所以这是一个非常非常极端的无权利保留协议。