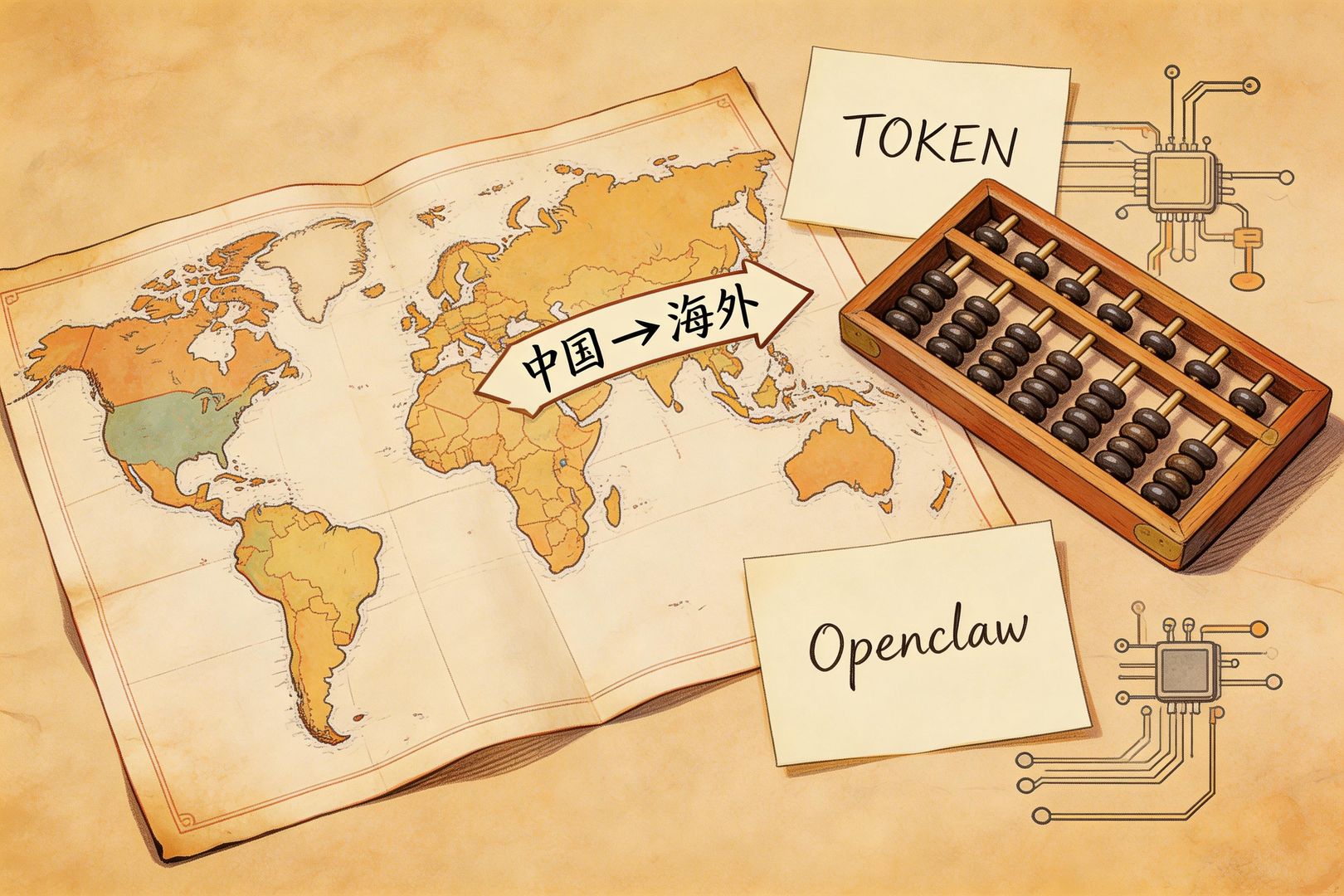

Openclaw带动的中国 TOKEN 出海,会不会压垮美国 AI 公司的嵌套游戏呢?

大家好,欢迎收听老范讲故事的 Youtube 频道。

中国 TOKEN 出海:一个全新的叙事

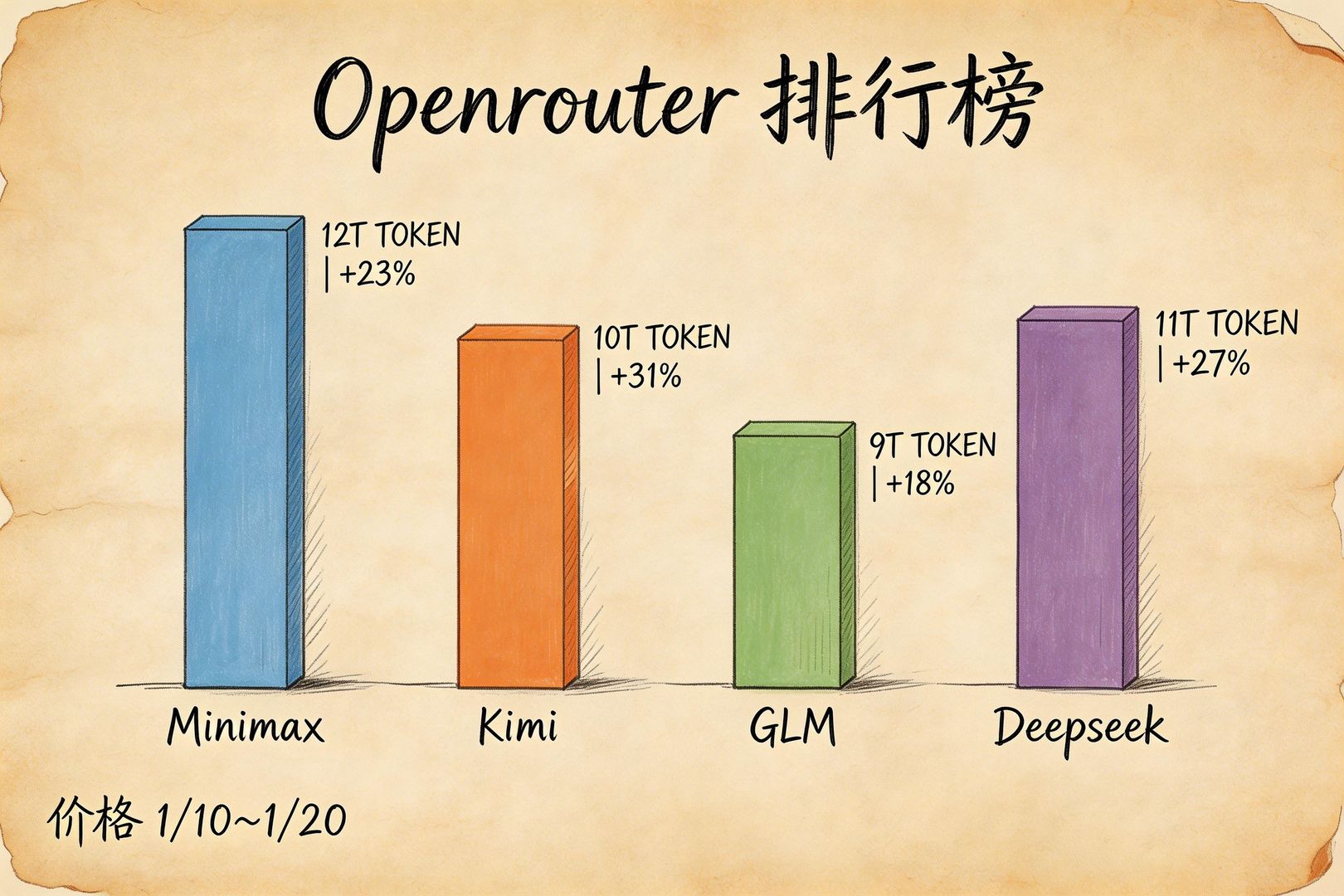

中国 TOKEN 出海是一个全新的叙事。Openrouter 上面做了一个最新的排行榜统计:

- 第一名 Minimax M2.5,单周 2.45 万亿 TOKEN,环比增长 197%

- 第二名月之暗面 Kimi K2.5,单周 1.21 万亿 TOKEN

- 第三名智谱 GLM5,单周 0.87 万亿 TOKEN,环比增长 158%

- 第五名 Deepseek V3.2

这四款模型合计贡献了前五名调用量的 85.7%。第四名咱们刚才没讲,是 Claude Opus4.6,用的也是很多的。第九名是千问 3.5 PLUS。

这是中国大模型在上面上榜的这些。中国 TOKEN 的价格只是美国同样 TOKEN 的 1/10 到 1/20。特别贵的就是 Claude Opus4.6,非常非常贵。

整体占比方面,平台前十名的模型 TOKEN 消耗量是 8.7 万亿,中国模型占 5.3 万亿,占比高达 61%。2 月第三周中国模型周调用量达到了 5.16 万亿 TOKEN,三周暴涨 127%;同期美国模型仅 2.7 万亿 TOKEN,实现历史性的反超。