春节临近,中国各大模型厂商都憋着劲要刷屏,要上大分。

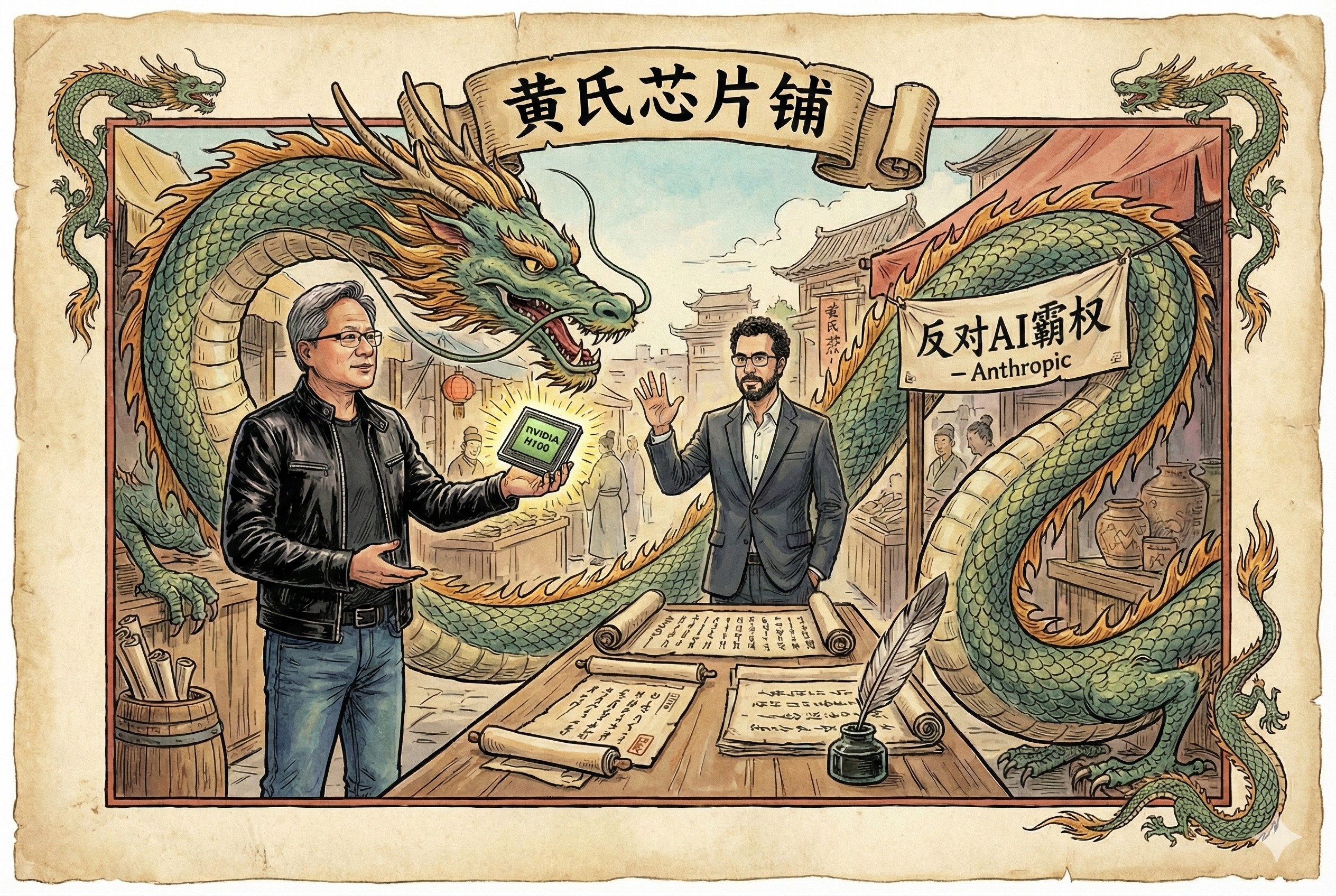

大家好,欢迎收听老范讲故事的YouTube频道。还记得去年春节吗?Deepseek给大家留下了极其深刻的印象,干崩了英伟达的股价,这个真的是非常非常不容易的。而且Deepseek发布之后,整个大模型的竞争就进入了下一个阶段。在Deepseek发布之前,大家还在看着OpenAI在这里优雅的表演各种的杂技;Deepseek发布以后,那大家就直接疯掉了。可以说是一石激起千层浪,所有人都在快速的迭代,快速的去推进各种各样的新模型。去年Deepseek R1的发布,不是说给了大家一个多么强的模型,而是把英伟达和OpenAI彻底拉下了神坛。

今天的故事分几块来讲:

- 第一个,Kimi 2.5的爆火;

- 第二个,字节跳动准备了大餐;

- 第三个,阿里千问3.5已经箭在弦上了;

- 再往后,Pony阿尔法到底是谁家的还不知道,但是智谱的股票已经涨疯了;

- 然后,Deepseek江湖上永远的传说;

- 海外模型厂商也都没闲着,他们也在努力准备应接我们的突袭。