VIDEO

伊利尔·苏斯克维的专访:他到底说了些什么?

大家好,欢迎收听老范讲故事的YouTube频道 。

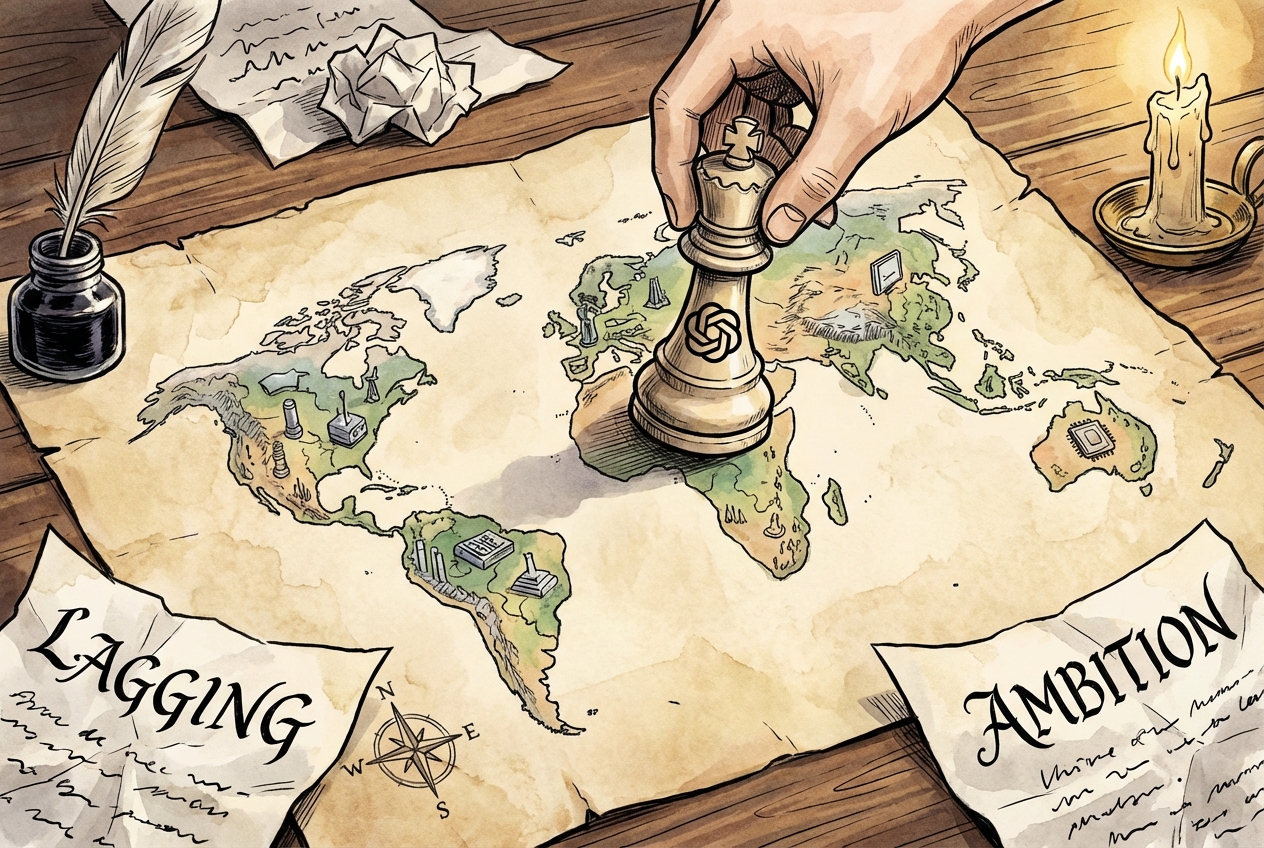

伊列尔·苏斯克维,很多人说:“这哥们是谁?”就是和马斯克、山姆·奥特曼一起创建OpenAI那哥们。在2023年11月份,对山姆·奥特曼进行逼宫以后,休假了很长时间,然后从OpenAI离职的。这一位算是OpenAI的创始人吧,他离职了以后呢,自己闷头去做研究,好长时间没有他的声音了,现在突然出来接受了一次专访。

引言:AI界的科学家与当下的迷茫

首先要注意,这哥们不是一个工程师,他是一个科学家。工程师跟科学家之间还是有很大差异的。使用确定的技术、加大投入、获得可预期的结果,这是工程师干的活;研究不确定的方向,这是科学家干的事情。所以,他是一位科学家。

现在很多人都在讨论AI是不是有泡沫。现在距离走通“最后一步”还有一点点小的差距。到底什么叫“最后一步”?就是AI真正的落地,真正的开始改变很多东西,开始挣钱。这一步现在还是有一点点差距的。但是呢,很多人也在否认AI泡沫的存在。AI虽然没有走通最后一步,但是AI真的带来很多失业。“钱我没挣着,但是我真的把人的工作干掉了。”现在是大家都比较迷茫的一个时间点。

原来那些应该默默无闻做研究的科学家,就携带了巨大的光环跑出来说话了。本来这些科学家说的话呢,应该是在很小的圈子里边流传,但是现在大家看看李飞飞、杨乐坤,包括今天咱们讲的伊利尔说的这些话,也成为了大众讨论的话题。

核心观点一:科学研究与工程研发的转化

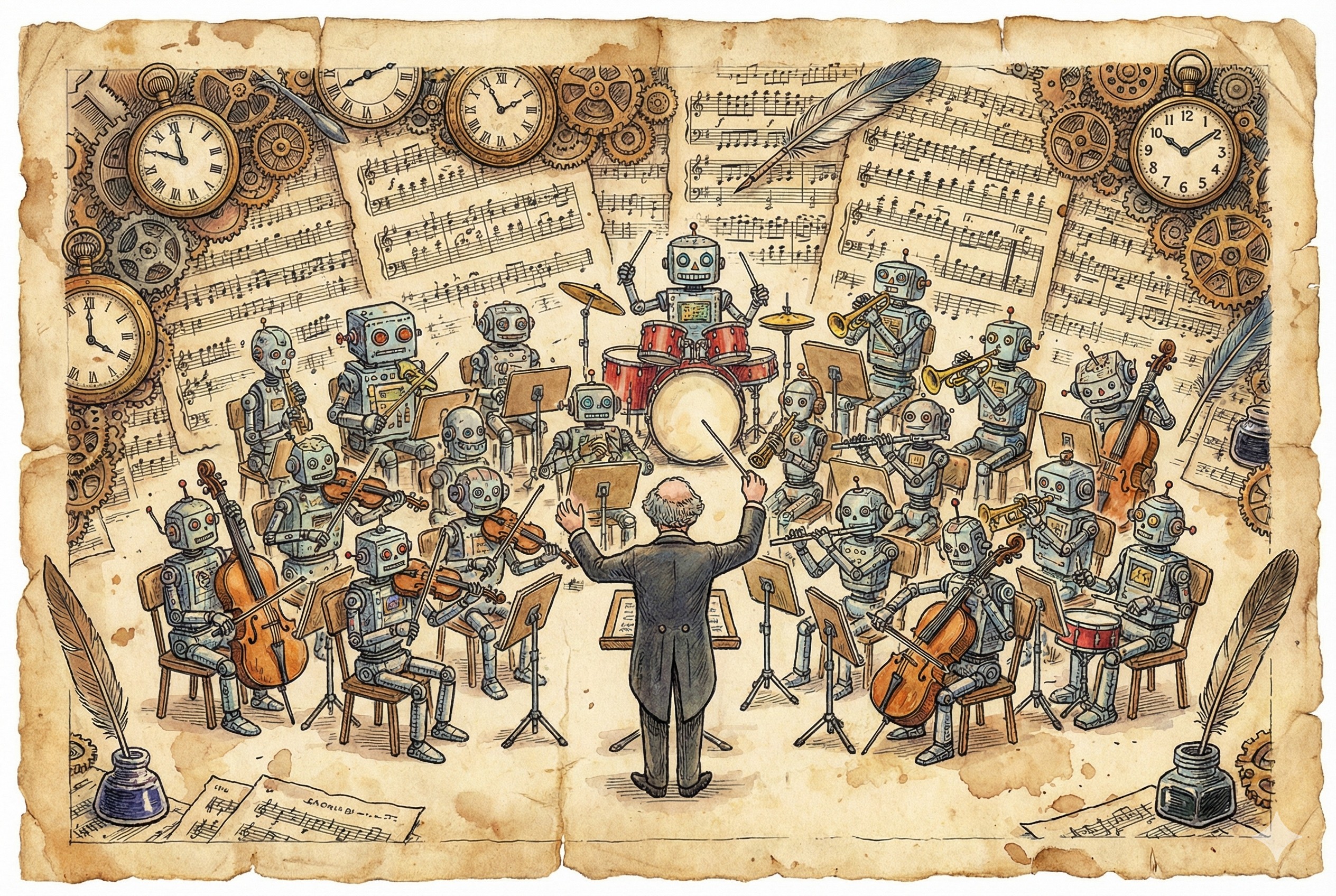

“科研现在需要相互转化了”,这就是这一次伊利尔访谈的一个核心观点。你说,科研科研不是一回事吗?不是,科学跟研究是两回事,它是分为“科学研究”和“工程研发”,它是两个不同的概念。

科学研究呢,是在发现方向。发现了方向以后,就可以堆钱、堆算力、堆数据,在各种行业里边进行测试,这个呢都叫工程研发。就像前面他们研究了半天,到底哪个算法是可以把这个大模型做出来的,最后发现Transformer算法是可以搞定的,发现方向了。到发现Transformer方法有效之前,都是在做科学研究。在Transformer出来以后,大家说:“咱们堆钱吧!”玩这个scaling law,就是直接往里头去堆算力、堆数据、堆这些东西了,这就开始玩工程研发了。这个都是确定的东西,我们只管往里堆钱就完了。

工程研发呢,有一个不可避免的问题,就是你万一站到了一个小山头上,朝任何一个方向走都是下坡。工程研发的时候,他也是会寻找更高的一个山头往上爬,但是你爬到一个最高的山头的时候,你就没法往前走了,因为你不知道应该往哪个方向走了。如果有一个离你很近的山头,你还可以去尝试的跳一跳;如果下一个山峰离你非常遥远的话,这个工程研发是没有办法去跨越鸿沟的。那么在这个时候就应该重新走回来,做科学研究了,重新去尝试那些现在不确定的方向。这就是这一次伊利尔访谈的一个核心观点。

所有的科学家最大的能力是不是科学?其实不是这样。所有的科学家,特别是成功的科学家,他们最大的能力是筹措经费和资金。特别是现在这个时间点,任何一项科学研究都是需要海量资金去堆砌的。现在已经不能说科学家坐在家里头,闭门造车多少年,最后研究出一个神奇的东西出来,现在已经过了那个时间点了。

阅读更多